Sztucznej inteligencji udało się oszukiwać z najlepszymi, jakie ludzkość ma do zaoferowania, po odkryciu exploita w klasycznej grze zręcznościowej Q * bert i uruchomieniu z nim.

Podczas gdy wcześniejsze iteracje sztucznej inteligencji grałyby poprawnie Q * bert, w pewnym momencie, gdy dowiaduje się, jak działa gra, odkrywa exploit, który pozwala jej zbierać szalone punkty. Oczywiście, jak zrobiłby to każdy gracz poszukujący punktów, powtarza ten proces, aby zwiększyć swój wynik w najbardziej efektywny sposób.

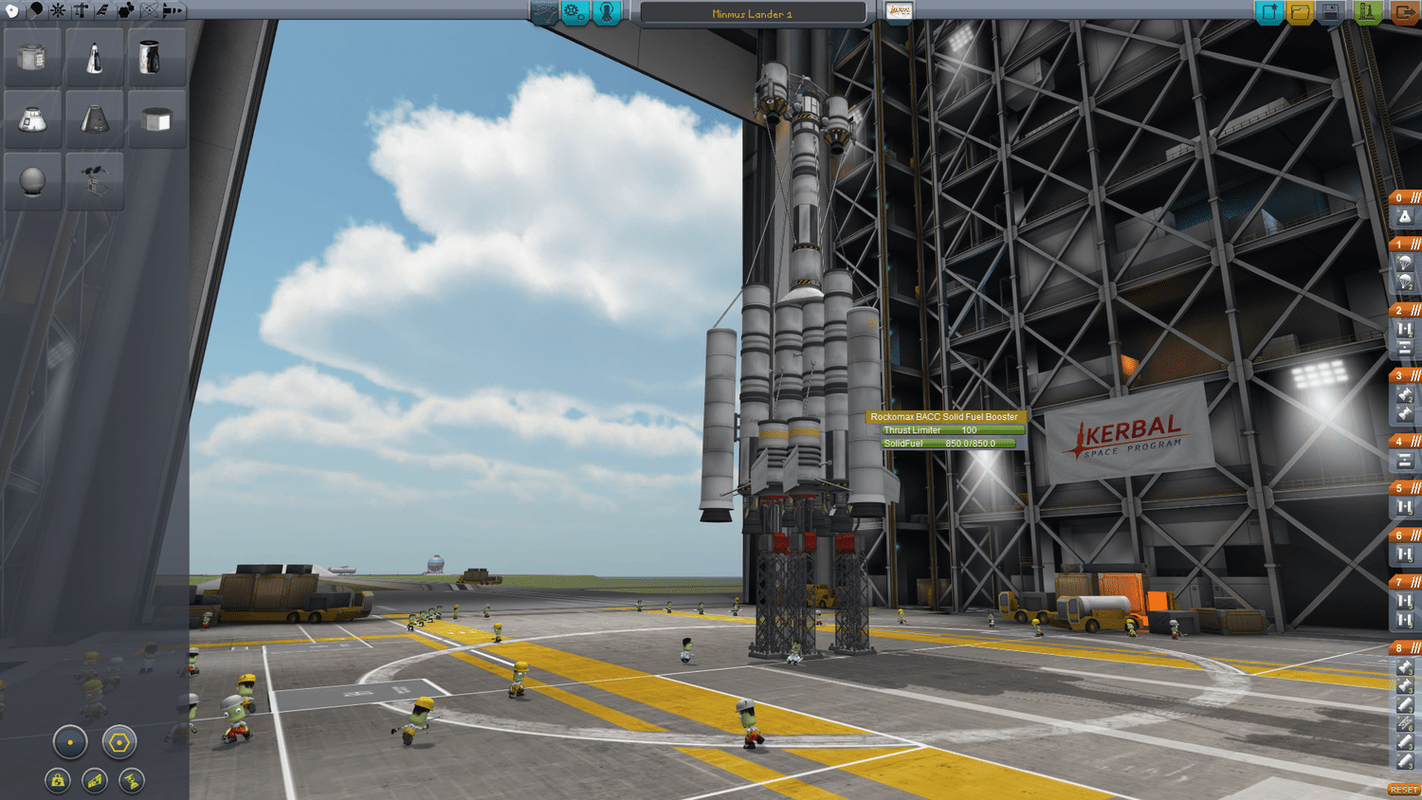

Na poniższym filmie możesz zobaczyć, jak sztuczna inteligencja porusza się po platformach. Na początku wygląda na to, że przeskakuje bez celu między platformami. Zamiast widzieć postęp gry do następnej rundy, Q * bert utknie w pętli, w której wszystkie jej platformy zaczynają migać - to tutaj sztuczna inteligencja może następnie przejść do szału punktowego, zbierając ogromne punkty.

CZYTAJ DALEJ: Jeden z najbardziej kontrowersyjnych rekordów gier został w końcu zdyskredytowany

jak naprawić podwójne kliknięcie myszą

Jak sztuczna inteligencja wygrała wojnę Q * bert

Bijąc rekord wszechczasów w tytule, sztuczna inteligencja zdobyła niewiarygodnie wysoki wynik dzięki programowaniu algorytmów strategii ewolucji. Strategie ewolucji (ES) różnią się od zwykłego uczenia się ze wzmocnieniem (RL), z którego korzysta tradycyjna sztuczna inteligencja, ponieważ jest postrzegane jako bardziej skalowalne ze względu na uczenie się przez pokolenie.

Każda pętla uczenia się jest określana jako generacja i kontynuuje swoje zadanie, dopóki nie zostanie spełniony ustalony warunek (w tym przypadku wysoki wynik). Z każdym kolejnym pokoleniem sztuczna inteligencja absorbuje wiedzę poprzedniego pokolenia i dlatego lepiej osiąga ten sam cel i przekracza go. Kontynuuj, a otrzymasz sztuczną inteligencję, która jest absolutnie bezkonkurencyjna w swoim zadaniu. Dokładnie tak się stało z wynikiem Q * bert.

Przedstawione w papier , opublikowany w zeszłym tygodniu przez naukowców z Uniwersytetu we Freiburgu w Niemczech, wygląda na to, że błąd nie był znaną ilością. W rzeczywistości, chociaż nie są zbyt zaskoczeni znalezieniem błędu, interesujące jest zobaczenie, jak sztuczna inteligencja poszła do przodu i nauczyła się wykorzystywać ją za każdym razem, gdy grała, aby zmaksymalizować swój potencjał punktacyjny.

CZYTAJ DALEJ: Ta sztuczna inteligencja uczyła się opanowywać Super Mario Bros.

Aby znaleźć błąd, agent musiał najpierw nauczyć się prawie ukończyć pierwszy poziom - nie zostało to zrobione od razu, ale przy użyciu wielu drobnych ulepszeń, wyjaśniają naukowcy Rejestr . Podejrzewamy, że w pewnym momencie szkolenia jedno z potomnych rozwiązań napotkało błąd i uzyskało znacznie lepszy wynik w porównaniu z rodzeństwem, co z kolei zwiększyło jego wkład w aktualizację - jego waga była najwyższa w średniej ważonej. To powoli przeniosło rozwiązanie w przestrzeń, w której coraz więcej potomstwa zaczęło napotykać ten sam błąd.

Nie znamy dokładnych warunków, w których pojawia się błąd; możliwe, że pojawia się tylko wtedy, gdy agent postępuje według wzorca, który wydaje się nieoptymalny [na przykład gdy agent marnuje czas lub nawet traci życie]. Gdyby tak było, to standardowemu RL byłoby niezwykle trudno znaleźć błąd: jeśli użyjesz nagród przyrostowych, nauczysz się strategii, które szybko przynoszą jakąś nagrodę, zamiast uczenia się strategii, które nie dają wielu nagród przez jakiś czas i potem nagle wygraj duże.

Zobacz powiązane Mistrz Dragstera Todd Rogers właśnie stracił koronę po 35 latach Ta sztuczna inteligencja uczyła się opanować Super Mario Bros 1-2 przez 17 dni Zobacz, jak sztuczna inteligencja uczy się jeździć w GTA V na Twitchu

Jednak pomimo wspaniałych wyników bota, naukowcy nie twierdzą, że jest to przypadek, w którym można opanować uczenie się ES zamiast RL. W rzeczywistości oba systemy mają swoje własne problemy, a połączenie tych dwóch jest w dużej mierze uważane za najlepszą opcję posuwania się naprzód.

Ta sama metoda ES w innych grach na Atari nie przyniosła prawie takich samych pozytywnych rezultatów. Z drugiej strony RL jest odpowiedzialny za bicie rekordów lewej, prawej i środkowej, w tym pokonanie najlepszego na świecie gracza GO. ES nadal ma swoje własne miejsce w rzeczach i tak naprawdę Nvidia wykonuje wiele szkoleń z AI, ponieważ wymaga większej mocy obliczeniowej, ale osiąga lepsze wyniki w dłuższym okresie.

Niezależnie od tego, która droga stanie się przyszłością dla rozwoju sztucznej inteligencji, przynajmniej ten bot oszukujący system nie jest taki zły teraz zhańbiony mistrz świata w grach wideo .